构建高效、安全、合规的大数据治理整体解决方案 数据处理篇

在数据驱动决策的时代,企业积累的海量数据既是核心资产,也带来了前所未有的管理挑战。有效的数据处理,作为大数据治理整体解决方案的核心环节,直接决定了数据资产的质量、可用性与价值。一个完整的、面向治理的数据处理框架,旨在将原始、杂乱的数据流,转化为清洁、可信、可用的数据资产,为上层分析与应用提供坚实基石。

一、 核心理念:从“处理”到“治理型处理”

传统的数据处理往往聚焦于技术实现,如ETL(抽取、转换、加载)的效率。而在治理视角下,数据处理被提升为一项贯穿数据生命周期的战略性活动。其核心目标不仅是完成数据移动与形态转换,更是要确保在处理过程中,数据的质量、安全、标准与合规性得到同步落实与增强。这意味着数据处理流程必须与数据质量管理、元数据管理、数据安全策略等治理域深度集成。

二、 关键组成模块

一个治理导向的数据处理解决方案通常包含以下关键模块:

1. 多源异构数据集成与采集:

建立可扩展的接入框架,支持从传统数据库、数据仓库、APaaS、物联网终端、日志文件、外部API等多种源头,以实时流或批量方式平稳、安全地采集数据。强调对数据源的元数据自动发现与血缘追溯的起点记录。

2. 标准化数据清洗与质量提升:

这是治理的核心。通过预定义的业务规则、数据质量标准(如完整性、准确性、一致性、唯一性、及时性),自动检测并处理缺失值、异常值、重复记录、格式不一致等问题。建立数据质量稽核点,并生成质量评估报告,形成闭环管理。

3. 规范化转换与整合:

依据企业统一的数据模型和业务术语(如主数据、参考数据),对数据进行结构转换、代码统一、业务逻辑计算(如指标衍生)和实体关联。确保数据在整合后遵循一致的业务定义与格式,消除部门间的数据孤岛与语义歧义。

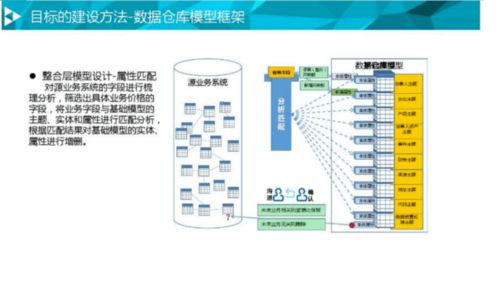

4. 分层存储与数据建模:

采用分层架构(如原始层、明细层、轻度汇总层、应用层)存储处理后的数据,平衡访问性能、存储成本与数据粒度。在明细层和汇总层,基于维度建模或数据仓库建模方法,构建清晰、稳定的数据模型,支撑灵活的分析需求。

5. 全链路元数据与血缘管理:

在处理过程中自动捕获并维护技术元数据(如数据结构、处理逻辑)、操作元数据(如作业执行状态、耗时)和业务元数据(如业务定义、负责人)。构建端到端的数据血缘图谱,清晰展示数据从源到目标的完整流动与变换过程,这是满足合规审计(如GDPR、CCPA)和影响分析的关键。

6. 内嵌的安全与隐私保护:

在处理流水线中集成安全策略,包括但不限于:数据分类分级、静态和动态数据脱敏(如对敏感个人信息)、访问控制列表(ACL)的传递、以及数据加密。确保敏感数据在处理的各个环节都得到恰当保护。

三、 技术架构支撑

为实现上述模块,现代解决方案通常采用混合技术栈:

- 批流一体处理引擎:如Apache Spark、Flink,提供高性能、高吞吐量的数据处理能力,支持复杂的转换逻辑。

- 数据集成与调度工具:如Airflow、DolphinScheduler,用于编排复杂的数据处理工作流,确保任务依赖与调度的高效可靠。

- 数据质量与管控平台:集成Great Expectations、Apache Griffin等工具,实现质量规则的配置、自动化检查与监控告警。

- 云原生与湖仓一体:越来越多地基于云平台(如AWS、Azure、阿里云)构建,采用数据湖与数据仓库融合的“湖仓一体”架构,兼顾数据湖的灵活性与数据仓库的管理治理能力。

四、 实施路径与持续运营

成功的实施始于明确的业务目标与治理章程。建议分阶段推进:

- 评估与规划:盘点现有数据资产、处理流程与痛点,明确优先级治理领域(如客户数据质量、合规报表)。

- 设计与试点:设计符合企业实际的数据处理流水线,选择关键业务场景进行试点,验证流程与技术框架。

- 推广与集成:逐步推广到更多业务域,并将数据处理平台与现有的数据目录、主数据管理、安全平台等深度集成。

- 监控与优化:建立持续监控机制,跟踪数据处理作业的性能、成本与数据质量指标,并持续优化规则与流程。

****

数据处理不再仅仅是IT后台的技术任务,而是企业数据治理战略落地的核心枢纽。一个将治理要求内嵌于每一步处理环节的整体解决方案,能够系统性地提升数据的可信度、安全性和可用性,从而最大化数据资产的业务价值,为数字化转型和智能决策奠定不可动摇的数据根基。

如若转载,请注明出处:http://www.antpainter.com/product/17.html

更新时间:2026-05-22 17:05:00