数据建模与数据处理 驱动智能决策的双引擎

在当今数据驱动的时代,数据建模与数据处理已成为企业挖掘数据价值、实现智能决策的核心环节。两者相辅相成,共同构成了从原始数据到业务洞察的完整链路,是任何数据分析、机器学习或商业智能项目不可或缺的组成部分。

一、数据处理:数据的“冶炼厂”

数据处理是数据分析流程的基石,其目标是将原始、杂乱、不一致的数据转化为干净、统一、可用于分析的高质量数据集。这个过程通常被称为数据预处理或数据清洗,主要包括以下几个关键步骤:

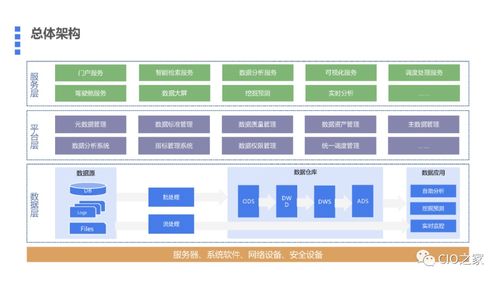

- 数据收集与集成:从数据库、API、日志文件、传感器等多种异构数据源采集数据,并将其整合到一个统一的视图或存储系统中。

- 数据清洗:处理数据中的错误、缺失值、异常值和不一致性。例如,填充或删除缺失数据,修正明显的错误录入,识别并处理超出合理范围的异常值。

- 数据转换与规约:将数据转换为更适合分析的格式。这包括标准化(如归一化)、数据离散化、特征构造(创建新的有意义的特征)以及数据降维(如主成分分析PCA)等技术,旨在提升数据质量并降低后续建模的复杂度。

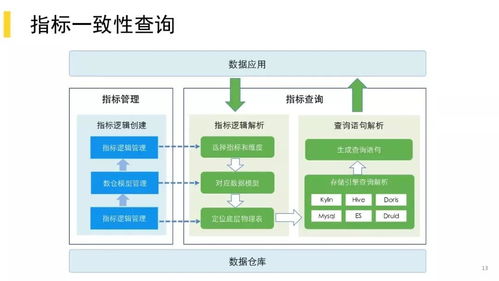

- 数据存储与管理:将处理后的数据高效、安全地存储起来,供后续访问和使用,常涉及数据仓库、数据湖等架构。

高质量的数据处理是成功数据建模的前提。正如谚语所说:“垃圾进,垃圾出”,低质量的输入数据必然导致不可靠的模型结果。

二、数据建模:数据的“设计师”

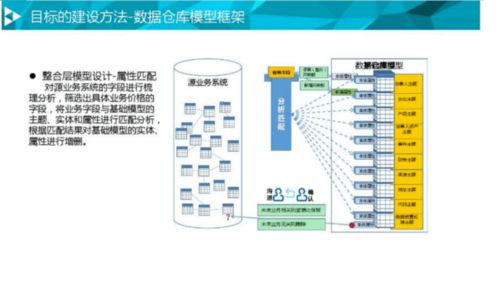

数据建模是在处理好的数据基础上,构建抽象模型以揭示数据内在规律、关系或进行预测的过程。它是将数据转化为知识和智慧的关键一步。根据目标不同,数据建模主要分为两大类:

- 描述性/统计建模:旨在理解和描述数据中已存在的模式和关系。例如,通过聚类分析对客户进行细分,或通过关联规则发现“啤酒与尿布”这样的销售组合。

- 预测性建模:利用历史数据构建模型,以预测未来或未知的结果。这是机器学习的核心领域,常用算法包括线性回归、决策树、随机森林、支持向量机(SVM)和神经网络等。例如,预测客户流失概率、股票价格走势或设备故障时间。

一个完整的数据建模流程通常包括:

- 问题定义与目标设定:明确业务问题,将其转化为可量化、可通过数据解决的分析或预测任务。

- 特征工程:基于领域知识,从已有数据中筛选、构造对目标预测最有价值的特征,这是模型性能优劣的决定性因素之一。

- 模型选择与训练:根据问题类型(分类、回归、聚类等)和数据特点,选择合适的算法,使用训练数据集对模型参数进行学习。

- 模型评估与验证:使用测试数据集评估模型的性能(如准确率、精确率、召回率、AUC等),并通过交叉验证等方法确保模型的泛化能力,防止过拟合。

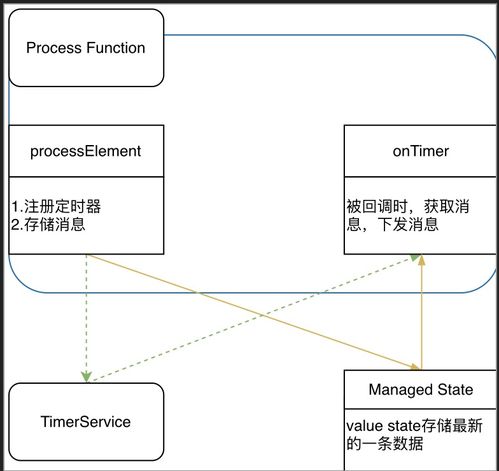

- 模型部署与监控:将训练好的模型集成到生产系统中,持续监控其性能,并根据新数据定期进行迭代优化。

三、协同共生:从数据到价值的闭环

数据处理与数据建模并非孤立的阶段,而是一个紧密协作、迭代循环的闭环系统。

- 数据处理为建模奠基:干净、规整的数据直接提升了模型训练的效率和最终效果。在建模过程中,特征工程的许多工作也属于数据处理的范畴。

- 建模反馈驱动数据处理优化:模型评估的结果常常会暴露出数据质量问题,或提示需要新的特征。例如,模型表现不佳可能源于某个关键特征的缺失,这反过来促使我们回到数据处理阶段,去收集或构造该特征。

- 共同服务于业务决策:两者的终极目标是一致的——将原始数据转化为可行动的洞见。处理后的数据通过有效的模型,输出为预测分数、分类标签、推荐列表或可视化报告,直接支撑运营优化、风险管控、精准营销等业务决策。

###

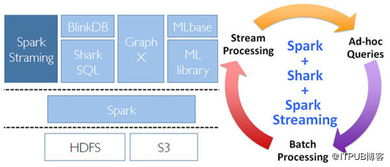

在人工智能与大数据技术飞速发展的背景下,数据建模与数据处理的能力已成为组织的核心竞争力。构建一个高效、自动化的数据处理管道(Data Pipeline),并在此基础上建立准确、可靠的数据模型,意味着能够更快、更准地从海量数据中提取黄金,从而在激烈的市场竞争中占得先机。理解并掌握这两大“引擎”,是迈向数据智能时代的必由之路。

如若转载,请注明出处:http://www.antpainter.com/product/10.html

更新时间:2026-05-18 10:22:50